Unterschied zwischen gleichzeitiger Computing und Parallel Computing

- 3659

- 309

- Prof. Dr. Dylan Hentschel

In vielen Bereichen werden die Wörter gleichzeitig und parallel synonym, aber nicht so in der Programmierung verwendet, wo es grundlegend unterschiedliche Konzepte beschreibt.

Was ist gleichzeitig Computing?

Das gleichzeitige Computing ist die gleichzeitige Ausführung mehrerer Rechenaufgaben in überlappenden Zeiträumen anstelle von sequentiell. Es ist die Fähigkeit eines Systems, mehrere Berechnungen gleichzeitig oder in überlappenden Zeitrahmen durchzuführen. Die Parallelität ist im Wesentlichen anwendbar, wenn Sie über mehr als eine Aufgabe gleichzeitig sprechen. Diese Aufgaben können als separate Programme oder als eine Reihe von Prozessen oder Threads implementiert werden, die von einem einzelnen Programm erstellt wurden. Die Aufgaben können auf einem einzelnen Prozessor, mehreren Prozessoren oder einem Netzwerk verteilt werden.

Das gleichzeitige Computing hängt mit dem parallelen Computing zusammen, konzentriert sich jedoch mehr auf die Wechselwirkungen zwischen Aufgaben. Parallelität bezieht sich gleichzeitig auf die Ausführung mehrerer Aufgaben, bedeutet jedoch nicht unbedingt gleichzeitig. Ob die gleichzeitig erfüllten Aufgaben ein Implementierungsdetail sind. Die Aufgabe kann auf einem einzelnen Prozessor durch unterbrochene Ausführung oder auf mehreren physischen Prozessoren ausgeführt werden. Ein häufiges Beispiel für Parallelität ist ein Programm zur Berechnung der Summe einer großen Liste von Zahlen.

Was ist paralleles Computer?

Parallele Computing ist der Prozess des gleichzeitigen Ausführens mehrerer Rechenaufgaben, indem verschiedene Teile der Berechnung an verschiedene Prozessoren delegiert werden, die gleichzeitig ausgeführt werden. Ein parallele Programm verwendet mehrere Prozessorkerne, um eine Berechnung schneller durchzuführen. Es wird gleichzeitig mit mehreren Prozessoren Teile von Aufgaben oder mehreren Aufgaben ausgeführt. Es ermöglicht einzelne sequenzielle CPUs, viele Dinge anscheinend gleichzeitig zu tun. Parallelität ist eine Verwirklichung eines gleichzeitigen Programms.

In einem Multi-Core-System können mehrere Programme ohne die Hilfe des Betriebssystems gleichzeitig Fortschritte machen, um Zeitschneide bereitzustellen. Wenn Sie ausführen, sagen wir zwei Prozesse auf einem Dual-Core-System und vergeben einen Kern pro Prozess, sie werden beide gleichzeitig ausgeführt. Dies ist, was Sie parallel ausführen können. Parallele Computing erfordert im Wesentlichen Hardware mit mehreren Verarbeitungseinheiten. Es ist die gleichzeitige Ausführung von Berechnungen, möglicherweise verwandt, aber nicht unbedingt.

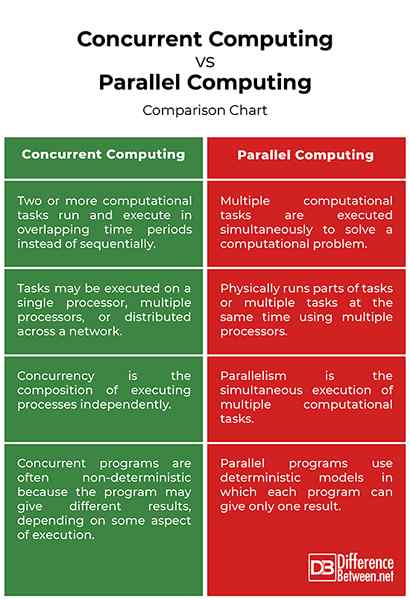

Unterschied zwischen gleichzeitiger Computing und Parallel Computing

Definition

- Das gleichzeitige Computing ist eine Form des Computer. Die Parallelität ist im Wesentlichen anwendbar, wenn Sie über mehr als eine Aufgabe gleichzeitig sprechen. Parallele Computing hingegen ist eine Art von Computerarchitektur, bei der gleichzeitig mehrere Rechenressourcen verwendet werden, um ein Rechenproblem zu lösen.

Ausführung

- In gleichzeitiger Computing können die Aufgaben auf einem einzelnen Prozessor, mehreren Prozessoren oder einem Netzwerk verteilt werden. Die Aufgabe kann auf einem einzelnen Prozessor durch eingezogene Ausführung oder auf mehreren physischen Prozessoren ausgeführt werden. Ein parallele Programm verwendet mehrere Prozessorkerne, um eine Berechnung schneller durchzuführen. Es wird gleichzeitig mit mehreren Prozessoren Teile von Aufgaben oder mehreren Aufgaben ausgeführt. Parallelität bezieht sich auf die Ausführung mehrerer Aufgaben gleichzeitig, aber nicht unbedingt gleichzeitig.

Verarbeitungsleistung

- Parallelität ist ein Programmstrukturierungsprozess, da es mehrere Kontrollfäden gibt. Konzeptionell werden diese Kontrollfäden gleichzeitig ausgeführt. Das heißt, Sie können sehen, wie ihre Effekte durchsetzt sind. Ein parallele Programm ist dasjenige, das mehrere Prozessorkerne verwendet, um eine Berechnung schneller durchzuführen. Ziel ist es, verschiedene Teile der Berechnung an verschiedene Prozessoren zu delegieren, die gleichzeitig ausgeführt werden.

Modell

- Gleichzeitige Programme sind häufig nicht deterministischer Nature, was bedeutet, dass sie tendenziell unterschiedliche Ergebnisse liefern. Ein gleichzeitiges Programm kann in verschiedenen Läufen unterschiedlich laufen. Parallele Programme verwenden deterministisches Modell, da das Ziel darin besteht, die Antwort schneller zu erhalten. Ein deterministisches Modell bedeutet, dass jedes Programm ständig nur ein Ergebnis liefern kann.

Gleichzeitiges Computing vs. Parallele Computing: Vergleichstabelle

Zusammenfassung

Kurz gesagt bedeutet, dass gleichzeitiges Computer ein Programm oder eine Aufgabe gleichzeitig unterstützt, aber nicht unbedingt gleichzeitig. Es ist der Prozess der unabhängigen Durchführung von Berechnungen. Paralleles Computer hingegen bezieht sich auf die gleichzeitige Ausführung von zwei oder mehr Berechnungen auf verschiedenen Prozessoren. Sie können sagen, dass alle parallelen Computer gleichzeitig, aber nicht umgekehrt sind. Parallele Computing ist mit einer einzelnen CPU nicht möglich; Stattdessen erfordert es ein Multi-Core-Setup.

Ist parallel Computing gleichzeitig?

Parallele Computing bezieht sich auf die gleichzeitige Ausführung von gleichzeitigen Aufgaben bei verschiedenen Prozessoren. Alle parallelen Programmierungen sind also gleichzeitig, aber nicht umgekehrt.

Was ist der Unterschied zwischen gleichzeitig und gleichzeitig?

Beide Wörter bedeuten „gleichzeitig“ und sind fast austauschbar, aber gleichzeitig impliziert Koordination, während gleichzeitig einfach gleichzeitig bedeutet. Gleichzeitig wird allgemein genauer verwendet, um zwei Ereignisse anzuzeigen, die sich in irgendeiner Weise überlappen, wie z. B. innerhalb des gleichen Zeitrahmens, jedoch nicht gleichzeitig.

Ist asynchronisiert?

Async ist ein Programmiermodell, während gleichzeitige Aufgaben ausgeführt werden. Asynchrone Operationen werden häufig als gleichzeitig bezeichnet, nur wenn sie Ressourcen teilen. In Async wissen Sie nie, welche Aufgaben zuerst ausgeführt werden werden. Hier gibt es also keine Parallelität.